Steeds meer experts waarschuwen voor nepinformatie dat gemaakt is door kunstmatige intelligentie (KI). Dat is een technologie waarmee computers taken kunnen uitvoeren die normaal door mensen worden gedaan.

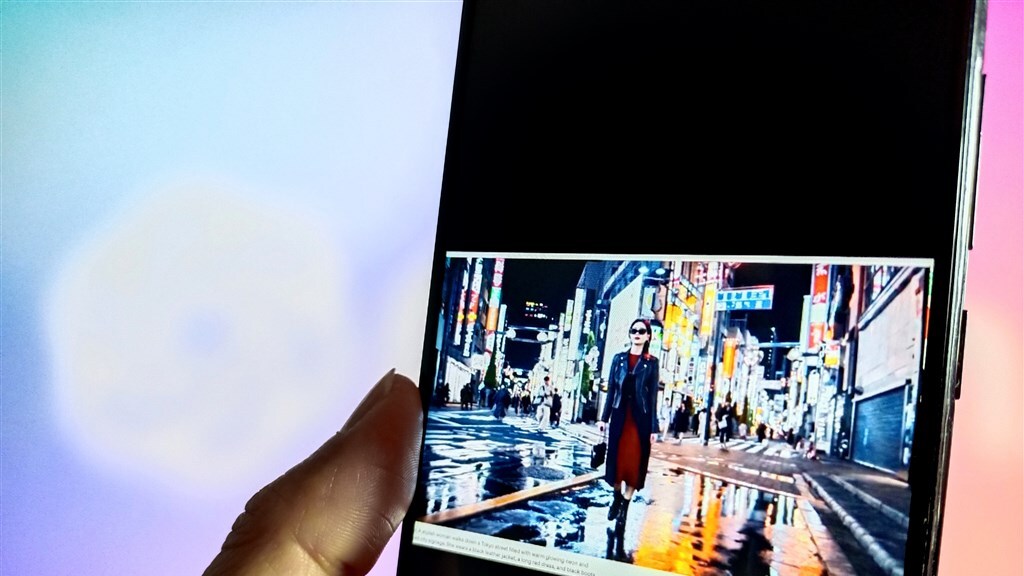

Sora is een nieuw slim computerprogramma van het bedrijf OpenAI dat teksten kan omzetten in levensechte video’s. Stel dat je wilt dat het een video maakt van een een vrouw die door Amsterdam loopt, dan kan Sora dat voor je maken. Dat lijkt dan een hele echte video, maar het is wel nep.

Sora wordt nu nog getest door een kleine groep mensen en is nog niet voor iedereen beschikbaar.

Experts zeggen dat het steeds moeilijker wordt om echte video’s van neppe te onderscheiden. Als Sora voor iedereen beschikbaar wordt, komt er een explosie van nepvideo’s en nepinformatie op sociale media.

Het probleem is niet nieuw. Nu al zijn er nepbeelden op de sociale media, zoals bij Israël en Palestina of zoals in Nederland, waar meisjes slachtoffer zijn van nepnaaktbeelden waar zij op staan.

Grote techbedrijven zoals OpenAI, Alphabet, Microsoft en Amazon gaan samenwerken om misbruik van KI tijdens verkiezingen te bestrijden.

Bijna de helft van de wereldbevolking gaat namelijk in 2024 naar de stembus. Daarom is het zeer belangrijk om nepinformatie te voorkomen.

De techbedrijven willen dat er meer regels komen over het gebruik van KI, maar zij zijn zelf ook de makers van KI. Ieder bedrijf wil de eerste zijn met nieuwe dingen. Dat gaat soms mis, waardoor die dingen weer aangepast moeten worden.

De Europese Unie werkt hard aan wetten en regels rond KI. Daarin staat bijvoorbeeld dat het maken van een nepvideo mag, maar dat wel duidelijk gezegd moet worden dat het nep is.

Volgens een expert zal elke organisatie, bedrijf en individu zich moeten afvragen: kun je verantwoord nepvideo’s maken? Soms zal het antwoord ook gewoon nee zijn.